מדריך חדש של משרד המשפטים מלמד שימוש בטוח ב-GenAI

הרשות להגנת הפרטיות הציגה המלצות קריטיות לציבור הרחב כיצד להשתמש במערכות בינה מלאכותית יוצרת מבלי לסכן את הפרטיות האישית

בעידן הטכנולוגי המתפתח במהירות, בו מערכות בינה מלאכותית יוצרת (GenAI או Generative AI), כמו ChatGPT, Dall-E, ג'מיני (Gemini), קלוד (Claude), ומידג'רני (Midjourney), הפכו לכלי נפוץ בחיי היומיום שלנו, עולה הצורך הדחוף להבין את השלכות השימוש בהן על פרטיות המשתמשים. לאור זאת, הרשות להגנת הפרטיות במשרד המשפטים פרסמה כעת לראשונה מדריך שימושי לציבור הרחב, המכיל המלצות ברורות לשימוש אישי וביתי במערכות אלו, במטרה להגן על הפרטיות.

הסכנה מתחילה בפרומפט: כך מידע תמים הופך לסיכון פרטיות

מערכות הבינה המלאכותית היוצר נועדו על מנת לייצר תוכן חדש (כגון טקסטים, תמונות, סרטונים ומוזיקה) על בסיס מידע אימון ושאילתות קצרות המכונות – טקסט מכוון זה שאנו כותבים או אומרים לצ'טבוטים מכונה 'פרומפט'. לפי הרשות להגנת הפרטיות, הסיכון המרכזי לפרטיות שלנו טמון במידע המוזן על ידי המשתמש במהלך יצירת הפרומפטים, משום שהרצון שלנו להשיג תוצאות איכותיות ומותאמות אישית מזמין לעיתים קרובות הזנה של מידע אישי, לעיתים רגיש ובהיקף ניכר.

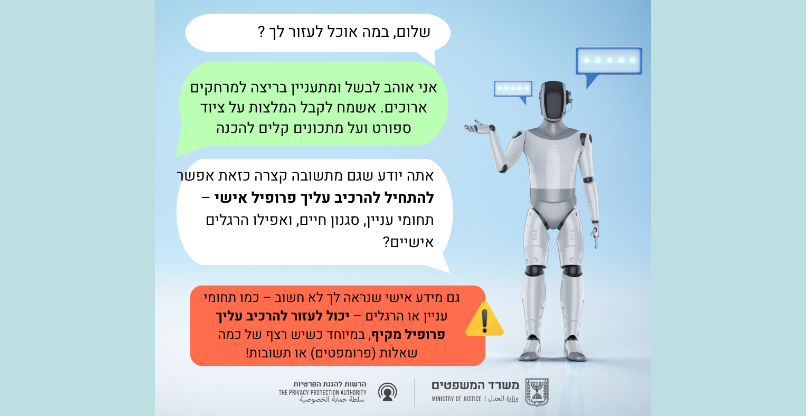

"כל פרומפט (מידע והוראות) שאתם מזינים במהלך השימוש עשוי לכלול מידע אישי – ובלי לשים לב, אתם חושפים על עצמכם הרבה יותר ממה שהתכוונתם", הסבירו ברשות. לדוגמה, הם הציגו פרומפט תמים לכאורה בו נכתב בפרומפט לצ'טבוט: "אני אוהב לבשל ומתעניין בריצה למרחקים ארוכים. אשמח לקבל המלצות על ציוד ספורט ועל מתכונים קלים להכנה". אלא שלפי ההסברים, פרומפט שכזה יכול להצביע על אורח חיים פעיל, מצבו הבריאותי של הכותב ואף לרמוז על בעיות אורתופדיות או צורך בשיקום בשילוב עם מקורות חיצוניים. לפי הרשות, שילוב מידע מתוך השאילתה עם נתונים ממקורות והצלבת מידע אישי נוסף עלול "לאפשר הסקה של מידע אישי". ברשות להגנת הפרטיות הסבירו כי כאשר מוזנים מספר פרומפטים לאורך זמן, גם אם כל אחד מהם נראה שגרתי, ניתן להרכיב מהם פרופיל אישי מקיף ומדויק להפליא של האדם. הפרופיל הזה יכול להיות אפילו יותר מדויק אם גם מידע נוסף – שנחשף מנתונים הנאספים כגון שמירת היסטוריית הפעילות, חשבונות משתמש, מיקום ההתחברות ונתוני מערכת ההפעלה – יצורף לצורך יצירתו.

סיכוני אבטחת מידע וחשיפת מידע לצד שלישי

ברשות הסבירו כי בדומה לכל מערכת דיגיטלית, גם מערכות בינה מלאכותית יוצרת חשופות לסכנת תקיפה. לפי ההסבר, במידה שתוקף מקבל גישה לחשבון המשתמש או למערכת ה-AI עצמה, הוא יכול לקבל גישה, בין היתר, להיסטוריית ההוראות (פרומפטים) וכך לקבל מידע אישי רב אודות המשתמש.

שילוב מידע זה עם מקורות גלויים נוספים, כך לפי הרשות, יכול כבר להוות איום פוטנציאלי משמעותי לפרטיות. כמו כן, מידע אישי זה שנשמר במערכת עלול לשמש לאימון האלגוריתם, להשפיע על תוצרים עבור משתמשים אחרים, ואף להופיע בתוצר שהצ'טבוט יתבקש להפיק עבור משתמש אחר. העברת מידע אישי לצד שלישי עלולה גם להיות מנוצלת לדיוג (Phishing), ליצירת אמון, לחשיפת פרטים על חברים ומשפחה, או לפרסום ממוקד.

עלולים לסכן את פרטיותכם. פרומפטים לא מוקפדים שנכתבו ל-GenAI. צילום: הסברה - משרד המשפטים

המדריך: כלים לשימוש חכם ואחראי

המדריך שפורסם אינו מבקש למנוע את השימוש במערכות ה-GenAI – להפך! הוא נועד לתת כלים להתנהלות נכונה של המשתמשים בהיבטי ההגנה על פרטיותם ברשת, וכן לאפשר למשתמשים להפיק מהטכנולוגיה החדשנית את המיטב, באופן מודע, אחראי ובטוח.

יצוין כי ההמלצות במדריך מיועדות לשימוש אישי וביתי בלבד, ואינן עוסקות בשימוש עסקי, מקצועי או ארגוני, אשר מוסדר בהנחיות נפרדות של הרשות.

המדריך מציע שורת המלצות ברורות שיסייעו להקטין את הסיכון לפרטיות:

- צמצמו הזנה של מידע אישי שאינו נדרש: מומלץ, ככל האפשר, להזין למערכות ה-AI רק את המידע הנחוץ והקריטי לקבלת התוצר הנדרש וכן צוין כי כתיבה כללית וממוקדת בשאלה עצמה תפחית את הסיכון לחשיפת מידע אישי.

- הימנעו מאזכור פרטים מזהים ומידע רגיש: גם עם בכלי הבינה המלאכותית אין לשתף פרטים מזהים כמו שם, גיל, מיקום, מצב משפחתי או מקצוע, אלא אם הם הכרחיים לשאלה. בפרט, אין לחשוף מידע רגיש כגון מידע רפואי (כולל פרטי ביטוח), מידע פיננסי (כמו מספרי חשבון בנק או כרטיסי אשראי), או מידע אישי רגיש אחר אודות המשתמש או אחרים (כגון ילדיו…).

- נסחו שאלות כלליות והשמיטו פרטים מיותרים: במקום "אני מחפשת", השתמשו ב"מה הם", "אילו", או "איך". התמקדו במידע הנדרש לתשובה והשמיטו פרטים מיותרים שאינם קריטיים, כמו מספר הילדים או המיקום המדויק. לדוגמה, במקום "אני אמא לשלושה ילדים קטנים, גרה בירושלים ומחפשת רעיונות להפעלות בסוף השבוע לילדים בגילאי 4-8", נסחו "הצג לי בבקשה רעיונות להפעלות שמתאימות לילדים בגילאי 4-8 באזור ירושלים בסוף השבוע".

- השתמשו בהתממה (אנונימיזציה): מומלץ להשתמש בהכללה או ב"רעש" (שינוי ערכים אקראי) כדי לטשטש פרטים אישיים מזהים, אך עדיין לאפשר קבלת תוצר רלוונטי ומותאם. לדוגמה, במקום לציין גיל מדויק של ילדים, ניתן לציין "גילאי יסודי".

- בקשו למחוק מידע אישי מהמערכת: במידה וקיימת אפשרות, בקשו מפעם לפעם מהכלי עצמו למחוק את כלל המידע האישי או פרטים מסוימים שהמערכת שמרה אודותיכם. וכן מומלץ לבדוק את היקף המידע האישי ששמר כלי הבינה המלאכותית היוצרת אודותיכם.

- שקלו לבטל אישור לאימון המודל על מידע המוזן: אם קיימת אפשרות בהגדרות, מומלץ לשקול לבטל את האפשרות של אימון מערכת הבינה המלאכותית על המידע המוזן אליה, כדי לצמצם את הסיכון לפרטיות. בדקו האם נאספים נתוני מיקום ושימוש שלכם ושקלו לבטל איסוף זה גם כן בעדכון העדפותיכם בהגדרות, אם אפשרות כזו קיימת. בנוסף, בדקו האם קיימת סקירה אנושית של השיחות שלכם עם הצ'טבוט – ובטלו אותה אם אפשרות כזו קיימת.

- עקבו אחר שינויים במדיניות הפרטיות: תנאי השימוש ומדיניות הפרטיות של מערכות הבינה המלאכותית היוצרת משתנים מעת לעת. מומלץ לעקוב אחר השינויים, במיוחד במערכות העיקריות בהן אתם משתמשים, ולערוך בהתאמה שינויים בהגדרות הפרטיות שלכם, כדי להגן על פרטיותכם ברשת.

לדברי הרשות להגנה על פרטיות המסר ברור: "הבינה המלאכותית יכולה לשפר את החיים שלנו – אבל זה תלוי בנו. נשתמש בה – אבל נשתמש בה נכון". המדריך נועד לסייע לציבור לנווט בבטחה בעולם הבינה המלאכותית ולמקסם את יתרונותיה תוך שמירה קפדנית על הפרטיות.

תגובות

(0)