חושפת את עצמה: כלי חדש של OpenAI מזהה תמונות של DALL·E 3

החברה המובילה בתחום הבינה המלאכותית הג'נרטיבית החליטה לקדם שקיפות סביב תוצרי הכלים שלה, והכריזה על מזהה שידע לאתר האם אימג' מסוים הוא עבודה של ה-GenAI שלה, אם לאו

באחרונה מתחיל להתחוור ליותר ויותר גולשים כי הגענו לשלב שבו ההבחנה בין ויז'ואל אמיתי למלאכותי מטשטשת. OpenAI, מפתחת כלי הבינה המלאכותית היוצרת ומודלי השפה הגדולים שמאחוריהם, עשתה כעת צעד מבורך לקראת שקיפות של תוצרי הכלים שלה.

החברה השיקה כלי מסווג (Classifier) שיסייע למשתמשים לזהות תמונות שנוצרו על ידי GenAI. האמצעי החדש, שנמצא כעת בבדיקה, מתגאה ברמת דיוק מרשימה של 98% בזיהוי תמונות, אבל רק כאלו שנוצרו על ידי DALL·E 3 – מודל יצירת התמונות של OpenAI עצמה.

היוזמה החדשה הזו חורגת גם אל מעבר לגילוי מקור התמונות וכוללת גם שיטות סימון מים, שיאפשרו להותיר על היצרות חותם ברור המעיד על תוכן שנוצר בידי בינה מלאכותית.

"אנחנו עובדים על שיטות מקור חדשות כדי לעקוב אחר תוכן ולהוכיח אם הוא תוצר בינה מלאכותית", הכריזה OpenAI בפוסט בנדון, שפורסם באחרונה בבלוג החברה.

Introducing a new classifier to help researchers identify content created by DALL·E 3.

We are also joining the Coalition for Content Provenance and Authenticity (@C2PA_org) Steering Committee to promote industry standards. https://t.co/drgdTruJEf

— OpenAI (@OpenAI) May 7, 2024

"העולם זקוק לדרכים נפוצות לשיתוף מידע על האופן שבו נוצר תוכן דיגיטלי. תקנים יכולים לעזור להבהיר כיצד נוצר תוכן ולספק מידע אחר על מקורותיו בצורה שקל לזהותו בהרבה מצבים – בין אם התוכן הזה הוא הפלט הגולמי ממצלמה, או יצירה אמנותית מכלי כמו DALL·E 3", פתחה וכתבה החברה בפוסט שלה.

"היום OpenAI מצטרפת לוועדת ההיגוי של C2PA – הקואליציה למקור ואותנטיות של תוכן", בישרה החברה בפוסט.

"C2PA", המשיכה וכתבה החברה, "הוא תקן בשימוש נרחב להסמכת תוכן דיגיטלי, שפותח ואומץ על ידי מגוון רחב של שחקנים, כולל חברות תוכנה, יצרני מצלמות ופלטפורמות מקוונות. ניתן להשתמש ב-C2PA כדי להוכיח שהתוכן מגיע ממקור מסוים. אנו מצפים לתרום לפיתוח התקן, ואנו רואים בו היבט חשוב בגישתנו".

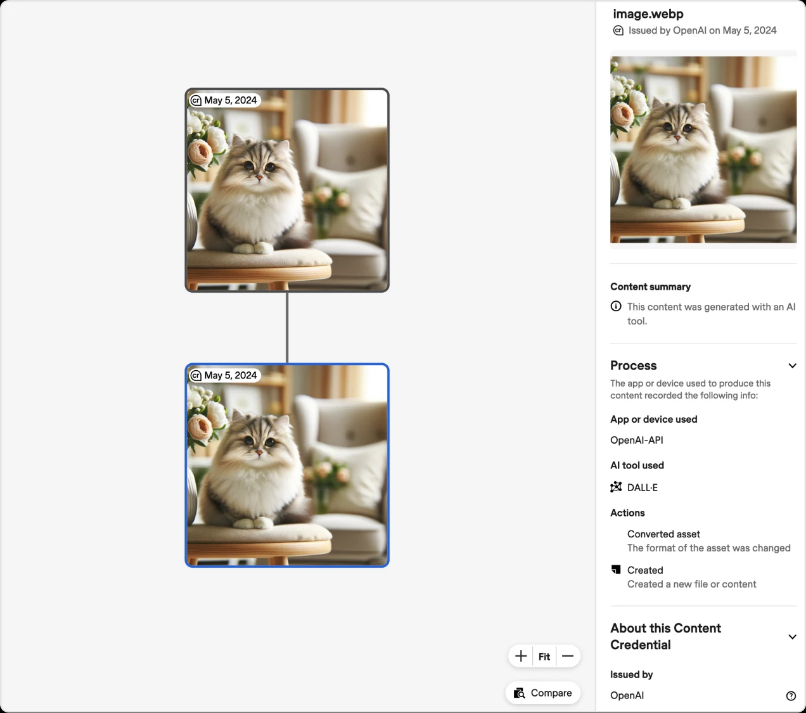

"מוקדם יותר השנה התחלנו להוסיף מטא נתונים של C2PA לכל התמונות שנוצרו ונערכו על ידי DALL·E 3, מודל התמונה האחרון שלנו, ב-ChatGPT וב-OpenAI API", המשיכה וסיפרה החברה שהצהירה: "נשלב מטא נתונים של C2PA עבור Sora, המודל שלנו ליצירת וידיאו, כאשר המודל יושק גם באופן נרחב".

הדגמה של יכולות המזהה החדש של OpenAI. צילום: OpenAI.

מהלך התחלתי לזיהוי האותנטיות החמקמקה ביצירות ה-AI

ההתפתחות הזו מגיעה בעיתוי קריטי בתחום הפורח של ה-GenAI, ממש בזמנים שהולך והופך ליותר ויותר קשה להבחין באותנטיות של תמונות המתפרסמות ברחבי האינטרנט בכלל וברשתות החברתיות בפרט.

הכלי של OpenAI הוא למעשה עניין מחויב המציאות בעידן הזה של הונאות דיגיטליות ונטייה להפוך פרסומים לוויראליים, לרוב ללא יותר מדי מחשבה על מה שעומד מאחוריהם והאם הם בכלל אמיתיים.

התוכנה החדשה של OpenAI אמורה לספק למשתמשים יכולת לנתח תמונה ולומר להם בדיוק כמעט מושלם אם היא מקורית או תוצר של מכונה. כאמור, לפי הבדיקות הפנימיות של OpenAI, לדבריה, הכלי כבר מתגאה בשיעורי הצלחה יוצאי דופן ובהצלחה כמעט מוחלטת לאיתור תמונות שיצרה ה-AI, גם אחרי שאלו עברו פעולות עריכה בסיסיות כמו חיתוך ודחיסה מטעם המשתמש.

אלא שכבר כעת ברור כי למרות שהוא חזק, למסווג/מזהה החדש של OpenAI יש מגבלות – ראשית, תמונה שעברה מניפולציה נרחבת או שינויים כמו התאמות גוון עלולה להטעות אותו. שנית, וחשוב מכך, כרגע הכלי מוגבל לזיהוי תמונות שנוצרו על ידי DALL·E 3. הכלי לא יוכל לזהות תמונות ממחוללי בינה מלאכותית אחרים כמו מידג'רני (Midjourney) או סטייבל דיפיוז'ן (Stable Diffusion) למשל.

המגבלה המסוימת של המזהה מבית OpenAI מעלה תהיות האם שחקנים זדוניים, המעוניינים לייצר הטעיות שונות, בכלל ימשיכו להשתמש בכלי "נשלט" המרוסן על ידי המפתחת שלו, כמו DALL·E 3, בהתחשב בעובדה שבשוק קיימים מחוללי תמונות זמינים, שתוצריהם בלתי ניתנים לאיתור וזיהוי, המאפשרים יצירת זיופים משכנעים במיוחד.

היוזמה של OpenAI היא ניסיון ראוי לשבח להתמודד עם סיכוני ה-AI היוצרת. בנוסף בחברה פתחו את תוכנית הבדיקות שלהם בפני חוקרים וארגוני עיתונות, בחיפוש אחר שיתוף פעולה כדי לחדד את יעילות הכלי. אבל לעת עתה המאמצים של OpenAI רק מסמנים צעד חיובי קטן לקראת עידן AI שקוף בהרבה, ומאבק רחב יותר נגד הונאה מקוונת. נקווה שהכלי החדש הזה הוא רק אקט פתיחה במאמץ לריסון היכולות המסוכנות הגלומות ב-GenAI.

תגובות

(0)