אם הבינה המלאכותית מובילה לטעות – מי ישלם את המחיר?

"התחום מעלה שאלות אתיות ורגולטוריות; אם רופא שוגה – אנחנו יודעים מה הנהלים לטפל בכך, אבל מה קורה אם מפתח גרם ל-'פספוס' בגילוי חולה סרטן?", שאלה לירון עזריאלנט, מנהלת שותפה בקרן Meron Capital

"תחום הבינה המלאכותית מעלה שאלות אתיות ורגולטוריות. אם רופא שוגה במהלך הטיפול בחולה, אנחנו יודעים מהם הנהלים לטפל בכך, ואם יש צורך – להענישו. אולם, אם מפתח גרם ל-'פספוס' בגילוי חולה סרטן – מי ישלם את המחיר?", כך שאלה לירון עזריאלנט, מנהלת שותפה בקרן Meron Capital.

עזריאלנט דיברה בכנס Future of AI Tel Aviv 2018. הכנס, בהפקת אנשים ומחשבים, נערך אתמול (ג') במלון דיוויד אינטרקונטיננטל בתל אביב, בהשתתפות יותר מ-1,200 איש. את הפאנל שהתקיים במליאה המרכזית הנחה הילל פולד, יועץ אסטרטגי.

לדברי עזריאלנט, "אנחנו מנסים לנבא מה יהיה הדבר הבא שלקוחות ירצו בתחום לימוד המכונה – ומה מביא תובנות בעלות ערך עסקי לארגון". היא ציינה כי "האתגר הגדול שניצב בפני חברות סטארט-אפ הוא להשיג מדעני נתונים. זה תחום גדל ויש בו מחסור, ומתקיים מאבק להשגת הכשרונות הטובים". "אתגר נוסף", ציינה, "הוא השגת הנתונים. לעתים לא האלגוריתמים הם הבעיה – אלא השגת הנתונים עבור החברות".

"מכונות עושות טעויות", אמרה עזריאלנט, "ונדרש שיפור מתמשך בתחום. הן גורמות לאנשים להיות פחות יצירתיים. היבט אחד מעלה דאגה, והוא אופן הפעולה של המכונות, שעובדות על בסיס דפוסים והיסטוריה. בדרך זו הן יוצרות ומחזקות תדמיות ודעות קדומות. כך, למשל, הן ימליצו למוסדות פיננסיים לתת פחות הלוואות למיעוטים או לאוכלוסיות חלשות. ככה משעתקים את הסטריאוטיפים".

רונה שגב, מנהלת שותפה ב-TLV Partners. צילום: ניב קנטור ותומר פולטין

רונה שגב, מנהלת שותפה ב-TLV Partners, אמרה כי "אנשים עושים שימוש יתר במינוח 'בינה מלאכותית'. אנחנו מתמקדים בלימוד מעמיק – Deep Learning. אין מספיק מומחים בתחום. אנחנו מביטים על החברות הפועלות בו בצורה מגזרית, כמו קמעונאות, אבל לעתים מבינים שיש צורך בהשקעה בחברות שפועלות בשכבת התשתיות. שם תהא תחרות עתידית עם יבמ (IBM) ו-AWS".

"תחום הבינה המלאכותית", אמרה שגב, "טומן בחובו שני אתגרים, ושם נשקיע: איך להשיג את הנתונים ואיך לעשות בהם שימוש מיטבי". לדבריה, "אנחנו לא דואגים מהשימוש ב-AI. אנשים חוששים תמיד משינוי, והנה – ב-100 השנים האחרונות, נשים התקדמו ויש פחות רעב בעולם. לימוד מעמיק לא יחליף בני אדם, אבל באחרונה נחשפתי לדוגמה כיצד התחום יכול לקדם את האנושות: חברה שפועלת בעולם זיהוי הפנים הצליחה להביא לאיתור של 5,000 ילדות ונערות נעדרות ממזרח אירופה, שכנראה נחטפו לטובת סחר כעובדות מין. חשבתי שהצעד הבא של ארגוני הפשיעה יהיה להשחית את פניהן של הנערות".

כמו כן, היא אמרה כי "אנשים חוששים ממכוניות אוטונומיות ולא מקדישים מספיק מחשבה לתאונות הנגרמות כיום על ידי נהגים שנטלו סמים, שתו אלכוהול או סימסו תוך כדי הנהיגה".

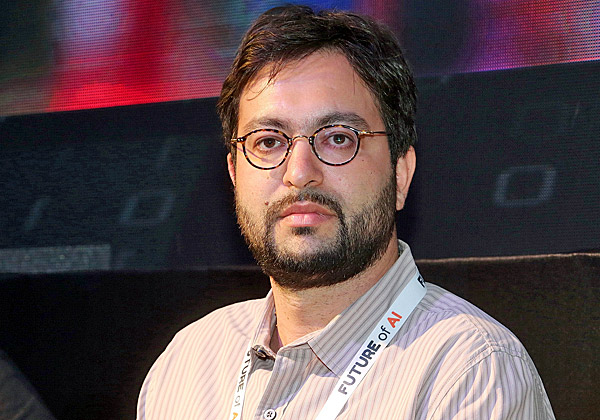

יגאל רייחלגאוז, מייסד משותף ומנכ"ל קורטיקה. צילום: ניב קנטור

יגאל רייחלגאוז, מייסד משותף ומנכ"ל חברת הראייה הממוחשבת קורטיקה, ציין ש-"האתגר בתחום הוא הנתונים, אבל יש להקפיד שלא לטבוע בהם". הוא הוסיף כי "יש בתחום הלימוד המעמיק לעתים טעויות, מה שיוצר בעיות אמינות לתחום".

טובי אולשנסקי, מייסד משותף ומנכ"ל Proov. צילום: ניב קנטור ותומר פלוטין

טובי אולשנסקי, מייסד משותף ומנכ"ל Proov, ציין כי "יש לנו ראייה שונה על בינה מלאכותית. אנחנו רואים מקרים רבים בהם חברות הפועלות בתחום מנסות להפוך כל תהליך לאוטונומי". אתגר נוסף שאותו ציין הוא "למצוא את הנתון הרלוונטי, בבחינת למצוא מחט בערימת שחת". הוא סיים באמרו כי "אני לא מפחד מבינה מלאכותית. היא הופכת להיות תחום הלכה למעשה. זה העתיד ואי אפשר להימנע מכך".

תגובות

(0)