ב-2026, פשעי הסייבר יהפכו למתועשים ואוטומטיים

אנו נכנסים לעידן של Zero Trust אנושי, לצד מעבר משמעותי לאימוץ AI אחראי, מבוקר ומבוסס-אבטחה ● תחזית איומי הסייבר לשנה שהחלה, פרק ד'

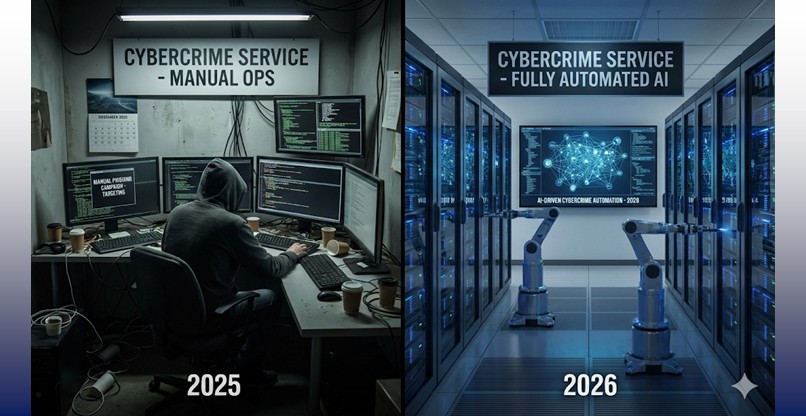

2026 תיזכר כשנה שבה פשיעת הסייבר חדלה להיות שירות המופעל ידנית – והפכה למערכת אוטומטית לחלוטין.

ראיין פלורס, ראש תחום מחקר איומים עתידיים בטרנד מיקרו. צילום: יח"צ

"השנה תסמן קפיצת מדרגה, בה בינה מלאכותית ואוטומציה יאפשרו לפושעי סייבר לנהל קמפיינים מקצה לקצה באופן כמעט אוטונומי, החל מסריקה ואיסוף מודיעין, דרך פריצה ותנועה רוחבית, ועד סחיטה וניצול כלכלי, מה שמייצר מהירות, היקף ומורכבות שלא נראו קודם ומאתגר את יכולת ההגנה והתגובה של ארגונים", כך לפי תחזית טרנד מיקרו. על פי החוקרים, התוקפים יתמקדו השנה בכמה נקודות כובד: סביבת הענן ההיברידי, שרשרת אספקת התוכנה ותשתיות ה-AI.

לדברי ראיין פלורס, ראש תחום מחקר איומים עתידיים ב-טרנד מיקרו, "אנו נכנסים לעידן שבו סוכני AI מגלים חולשות, מנצלים אותן וממנפים אותן כלכלית כמעט בלא מעורבות אנושית. מודלים של בינה מלאכותית יוצרת (GenAI) ומערכות סוכנים חכמים – משנים את כלכלת הפשע המקוון. האתגר אינו רק לזהות מתקפה – אלא לעמוד בקצב המכונה, שמכתיב את קצב האיומים".

החרפה דרמתית באיומי הנדסה חברתית

ליאור לאמש, שותף-מייסד ומנכ"ל GK8. צילום: תמי מונטג

לפי ליאור לאמש, שותף-מייסד ומנכ"ל GK8, "קפיצת המדרגה של ה-AI תביא להחרפה דרמטית באיומי ההנדסה החברתית. האיום המרכזי הוא מעבר ה-AI מיצירת תוכן – לניהול אינטראקציה חיה. צפויה כניסה מסיבית של סוכנים רובוטיים וטכנולוגיות Deep fake, המחקים אנשים. הטכנולוגיה מאפשרת לפושעים להפעיל מוקדי הונאה אוטונומיים, ולבצע מתקפות הנדסה חברתית בהיקף תעשייתי של אלפי שיחות במקביל, בלא צורך במעורבות אנושית. המסקנה חד-משמעית: אנו נכנסים לעידן של Zero Trust אנושי".

עליית ה-AI הפרטית

לדברי יואב קרומבי, מנכ"ל AGAT Software, "השנה נראה מעבר משמעותי לאימוץ AI אחראית, מבוקרת ומבוססת-אבטחה.

יואב קרומבי, מנכ"ל AGAT Software. צילום: יח"צ

עולם ה-AI בארגונים יאופיין בחמש מגמות: הראשונה, ממשל. ארגונים ידרשו אמון, בהירות ושליטה בכל שכבה במערך ה-AI שלהם. לכן ארגונים יובילו לאימוץ סוכנים שניתנים לבקרה, לביקורת ולמיפוי לתהליכי עבודה מוגדרים. השניה, עליית ה-AI הפרטית. תשומת הלב תעבור ממודלי שפה כלליים למודלים פרטיים ויעודיים: מודלים מבודדים, עם אימון ייעודי למגזר הספציפי שלהם. השלישית – מנגנוני בקרה והגנה בזמן אמת. פלטפורמות אבטחת AI יידרשו לספק ניטור בזמן אמת, אכיפת מדיניות וזיהוי חריגות. הרביעית היא חומת האש ל-AI: שכבת הגנה המנהלת גישה למודלים, התנהגות פרומפטים, הפעלת כלים וזרימת נתונים – עם פיקוח ריכוזי". המגמה החמישית, ציין קרומבי, היא "דפדפנים מבוססי סוכני AI. הם יוצרים משטח תקיפה חדש ולכן ארגונים יסווגו דפדפנים מבוססי סוכנים כסביבות בסיכון גבוה, המחייבות בידוד קפדני, בקרות מדיניות מתקדמות וניטור התנהגותי רציף. AI אחראי כבר אינו אופציונלי – הוא הבסיס לאמון ולתחרותיות ארוכת-טווח".

פער ההנהלות

מחקר שפרסמה חברת הביטוח אקסיס (Axis Capital) בסוף השבוע, העלה שיש פער הולך וגובר בין ההנהלה הבכירה לגבי האופן שבו מנהלים רואים את הסיכונים, התגמולים וההשפעה של טכנולוגיות AI מתקדמות: בעוד שמנכ"לים נוטים לראות ב-AI מנוע לפרודוקטיביות ויתרון תחרותי, מנהלי אבטחת המידע רואים בטכנולוגיה מקור לחשיפה מוגברת לסיכונים כמו דליפות נתונים.

סיכם וינסנט טיציו, מנכ"ל אקסיס: "כשחושבים על AI, זה לא רק אתגר סייבר. הטכנולוגיה הזו מציבה עומסים, התחייבויות, אתגרים והזדמנויות ייחודיים – למנכ"לים ולהנהלות. לא פגשתי מנכ"ל או חבר הנהלה שאינם מדברים על הצורך בשיח סייבר, בשל החשיבות הקריטית שלו ואיומי הסייבר על החברה שלהם".

תגובות

(0)