Red Hat AI 3 מאפשר לארגונים לעלות מהר יותר לייצור

פלטפורמת ה-AI ההיברידית של רד האט בענן מייעלת עלויות AI, מציעה יכולות הסקה (inference) חדשות ועוצמתיות ובונה את הבסיס לסוכני AI בסקייל

רד האט (Red Hat), הספקית המובילה בעולם של פתרונות קוד פתוח, הכריזה על Red Hat AI 3, התפתחות משמעותית של פלטפורמת ה-AI הדיגיטלית שלה. הפלטפורמה מסייעת להנגיש, לנהל ולאבטח כל מודל קוד פתוח ללא כל תלות במיקום, חומרה או תשתית.

כאשר ארגונים מתקדמים מעבר לעריכת ניסויים ב-AI, הם מתמודדים עם מכשולים משמעותיים הכוללים אתגרי אבטחה, בקרת עלויות וניהול מודלים מגוונים. Red Hat AI 3מתמקדת בהתמודדות ישירה עם אתגרים אלו על ידי מתן חוויה עקבית ואחידה ללא תלות במיקום פיזי, סוג החומרה או אופי התשתית. עם בסיס הבנוי על סטנדרטים פתוחים, Red Hat AI 3 פוגשת ארגונים במקומם הנוכחי במסע ה-AI שלהם ותומכת בכל מודל בכל מאיץ חומרה, ממרכזי נתונים עד לענן ציבורי וסביבות AI ריבוניות ועד לקצה הרחוק ביותר.

מהכשרה ל"עשייה": המעבר להסקת AI ארגונית

כאשר ארגונים מעבירים יוזמות AI לסביבות הייצור, הדגש עובר להסקה (Inference) – השלב בו המודלים פוגשים מידע אמיתי ולא סינטטי. Red Hat AI 3 שמה דגש על שכבת הסקה גמישה וחסכונית, באמצעות התבססות על פרויקטי הקוד הפתוח vLLMו-llm-d.

כדי לסייע למנמ"רים להפיק את המיטב מניצולת החומרה, Red Hat AI 3משיקה את llm-d, יכולת המעצבת מחדש את הדרך שבה LLMs פועלים באופן מובנה על קוברנטיס.llm-d מייצר שכבת הסקה חכמה, המאפשרת לפרוס, לאבטח, לייעל ולנהל מספר רב של LLMs בייצור, כאשר vLLM היא השכבה שדואגת לחיסכון בעלויות ואופטימיזציה של ביצועים.

החיבור ביניהם מאפשר לארגונים להפחית עלויות ולשפר את זמני התגובה באמצעות הנגשת מודלים כשירות (Model-As-A-Service), כולל אופטימיזציית משאבי GPU, שכבת חלוקת עומסים חכמה בין LLMs, אבטחה ואבלואציה על פני מאיצי חומרה שונים, כולל NVIDIA ו-AMD.

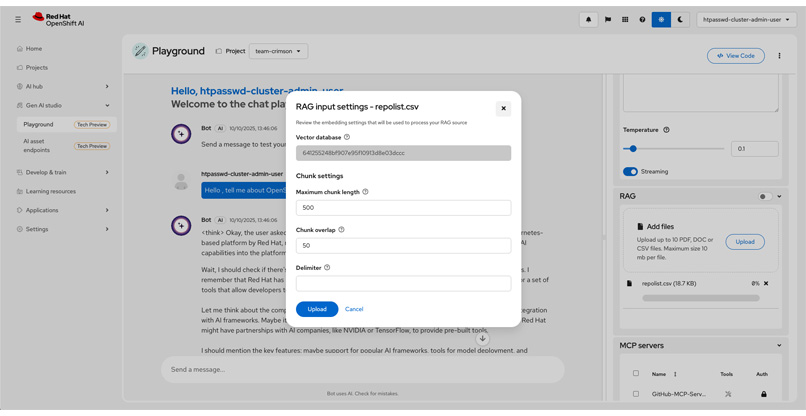

סביבת Red Hat AI 3 Playground. צילום: רד האט

פלטפורמת AI אחידה ועקבית

Red Hat AI 3 מספקת חוויה אחידה, עקבית וגמישה, המותאמת לדרישות לבניית פתרונות Gen AI מוכנים לייצור. הפלטפורמה נועדה לאפשר איחוד תהליכי עבודה בין צוותים באמצעות פלטפורמה אחת עבור מהנדסי פלטפורמה ומהנדסי AI למימוש אסטרטגיית ה-AI שלהם באמצעות יכולות מודל כשירות (MaaS), AI Hub, GenAI Studio ומודלים חדשים מאומתים ומותאמים של רד האט.

בניית הבסיס לסוכני ה-AI של הדור הבא

סוכני AI הולכים לשנות את האופן שבו יישומים בנויים ותהליכי העבודה האוטונומיים שלהם ייצרו עומס כבד על שכבת ההסקה. השקת Red Hat AI 3 מניחה את היסודות לסוכני AI לא רק באמצעות יכולות ההסקה שלה, אלא גם עם תכונות ושיפורים חדשים המתמקדים בניהול ופיתוח הסוכנים עצמם.

כדי להאיץ את פיתוח הסוכנים, רד האט הציגה שכבת API אחידה המבוססת על Llama Stack, המסייעת ליישר קו בין הפיתוח ותקני התעשייה, כמו פרוטוקולי ממשק LLM תואמי OpenAI. בנוסף, כדי לתמוך במרחב פעילות פתוח יותר, רד האט אימצה כבר בשלבים הראשונים את פרוטוקול MCP, תקן רב עוצמה ומתפתח, המייעל את האופן שבו מודלי AI מקיימים אינטראקציה עם כלים חיצוניים – תכונה בסיסית עבור סוכני AI מודרניים.

ג'ו פרננדס, סגן נשיא ומנכ"ל, היחידה העסקית ל-AI, רד האט, אמר, כי "כאשר ארגונים מרחיבים את ה-AI מסביבות הבדיקה לייצור, הם מתמודדים עם גל חדש של אתגרי מורכבות, עלויות ובקרה. עם Red Hat AI 3, אנו מספקים פלטפורמת קוד פתוח ברמה ארגונית הממזערת את המכשולים הללו. על ידי אספקת יכולות חדשות כמו Distributed Inference עם llm-d ו-Llama Stack כפלטפורמת בסיס לפיתוח סוכני AI, אנו מאפשרים לצוותי מהנדסי ה-AI להפעיל בביטחון רב יותר AI Workloads בתנאים שלהם, בכל תשתית".