שערוריית הפרטיות של ChatGPT: הדליף שיחות איתו לרשת

סיפרתם לצ'טבוט סודות? הוא יודע פרטים על העסק שלכם? חשיפה אחרונה מטלטלת את עולם ה-AI, אחרי שנודע כי שיחות משתמשים עם כלי ה-AI המוביל מבית OpenAI - שנועדו להישאר פרטיות - הפכו נגישות לכל בגוגל חיפוש

השערוריה החדשה הזו יכולה לתפוס אתכם קצת בהלם – באחרונה התגלה כי במהלך החודשים האחרונים שיחות שניהלו משתמשים בפלטפורמת ChatGPT של OpenAI על ידי שימוש בתכונת "שיתוף באמצעות קישור" (Shared link), התגלגלו להופיע בתוצאות החיפוש של גוגל.

התכונה נועדה במקור לאפשר למשתמשים לשתף תוכן שנוצר עבורם בידי הבינה המלאכותית, אך כעת היא הפכה למוקד של דיון מקוון נסער בנוגע לחשיפת נתונים וסיכוני פרטיות.

התופעה המאוד בעייתי שיצרה התכונה נבעה מכך שהקישורים המשותפים יצרו גרסה סטטית ולקריאה בלבד של השיחה של המשתמש עם הצ'טבוט, אשר התארחה בשרתי OpenAI. אף על פי שהשימוש בתכונה דרש מהמשתמשים להסכים במפורש – על ידי יצירת קישור ובחירה אופציונלית בתיבה שתהפוך את הקישור ל"ניתן לגילוי" – רבים לא היו מודעים כלל לסיכונים הגלומים בהסכמתם, ולכך שלמעשה בעשותם זאת הם מספקים נראות ציבורית לתוכן האישי שלהם. מה שקרה הוא שברגע שקישורים אלו שותפו ברשתות חברתיות או באתרים, הם יכלו להיכנס לאינדקס של מנועי חיפוש כמו גוגל או בינג, ובכך להפוך לנגישים לכל מי שידע לחפש אותם.

ניתוח הממצאים מצביע על כך שהמנגנון של ChatGPT לא הוגדר בתחילה למנוֹע אינדוקס של מנועי חיפוש, בין היתר עקב היעדר תגיות noindex או הגבלות robots.txt – מה שאפשר ל"זחלנים" (המלקטים דאטה ברשת) לארכב ולהציג את התוכן, ולהפוך חילופי דברים פרטיים – לחשופים לכל בפוטנציה.

התייעצויות פסיכולוגיות פרטיות הפכו לגלויות – ומה עם נתוני חברות?

היקף הדליפה מעורר דאגה: מחקרים ומשתמשים גילו מגוון רחב של שיחות באמצעות חיפושים פשוטים. הממצאים האלה כללו בין השאר הודעות אישיות, בקשות עבודה שהכילו שמות מלאים ופרטי קשר, דיונים על נושאים מסוכנים או לא חוקיים, תמונות פרטיות, הקלטות קוליות ואף התייחסויות לכתובות מגורים או בני משפחה. בנוסף, נחשפו אלפי שיחות שהכילו פרטים אישיים רגישים ביותר שמעולם לא נועדו לפרסום, כולל סיפורים אישיים הנוגעים להתמכרויות, לטראומות ולמשברי בריאות הנפש. אף על פי ש-ChatGPT לא מציג את שמות המשתמשים, היו מי שזיהו את עצמם בתכנים פשוט מעצם ההקשר האישי המפורט (למשל כמו תאריכי לידה, עיסוקים, מיקומים או אירועי חיים ספציפיים).

ההדלפה שנחשפה מטרידה במיוחד בהתחשב בכך שכמעט מחצית מהאמריקנים שהשתתפו בסקר השנה הודו שבשנה זו פנו אל מודלי השפה הגדולים, כמו ChatGPT, לשם שיתוף וקבלת תמיכה פסיכולוגית מהם.

ההערכות מצביעות על כך שיותר מ-100 אלף שיחות צ'אט שכאלו נכללו באינדקס של מנועי החיפוש. כך למשל, שאילתה פשוטה בגוגל חשפה קרוב ל-4,500 תוצאות, לפי הדיווחים, והטענות הן כי סביר להניח שמדובר בתת-הערכה של הנתון האמיתי.

חברות ועסקים המשלבים כלי GenAI בתהליכי העבודה שלהם הפכו מיד למי שנחשבים כפגיעים במיוחד, עם חשש מדליפות של קניין רוחני ואף מפתחות API ונתונים רגישים נוספים.

OpenAI הודיעה: התכונה הושבתה

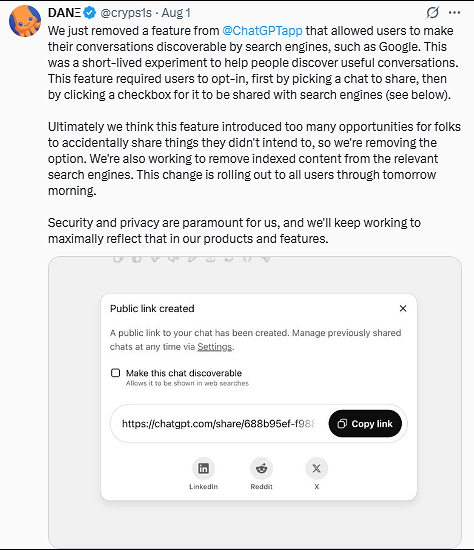

בתגובה לביקורת ולחשיפה, שהחלה כבר ביום ד' האחרון, בישרה OpenAI כי היא מבטלת את התכונה של שיתוףפ הקישור. בהצהרה שפרסם מנהל אבטחת המידע הראשי של החברה, דיין סטאקי, נאמר שהתכונה תוסר מאפליקציית ChatGPT כליל. לדבריו, OpenAI השביתה במהירות את האפשרות להפוך צ'אטים לניתנים לגילוי על ידי מנועי חיפוש, וסטאקי אף תיאר את התכונה ככזו שהייתה על תקן "ניסוי קצר-מועד" בלבד. הוא הוסיף, "אנו סבורים שבסופו של דבר תכונה זו יצרה יותר מדי הזדמנויות לאנשים לשתף בטעות דברים שלא התכוונו לשתף, ולכן אנו מסירים את האפשרות".

עם זאת, שיחות שכבר נכללו באינדקס של מנועי החיפוש נותרו גלויות, אלא אם כן המשתמש מחק אותן באופן פרטני. חשוב לציין, כי מחיקת שיחה מחשבון ה-ChatGPT אינה מסירה את הדף הציבורי המשותף. משתמשים חייבים למחוק ידנית כל קישור משותף דרך הגדרות ChatGPT תחת "בקרת נתונים" > "קישורים משותפים". גם לאחר המחיקה, ייתכן שיעבור זמן עד שמנועי חיפוש יסירו את התוכן מהתוצאות שלהם.

בעקבות התקרית, OpenAI עדכנה כי היא עובדת עם גוגל כדי להסיר את הקישורים המושפעים מהאינדקס. מומחים מייעצים למשתמשים לבדוק קישורים ששותפו בעבר ולמחוק את אלה שאינם רוצים שיישארו פומביים. כמו כן, מומלץ להשבית לחלוטין שיתוף קישורים ולהימנע מהכללת פרטים אישיים בשיחות עם הצ'טבוטים השונים, כאמצעים היעילים ביותר להגנה על הפרטיות.

🚨 SHOCKING: people are unknowingly making their ChatGPT interactions PUBLIC, and they are being indexed by Google (see my test below). My privacy recommendations:

When people interact with ChatGPT and use the "Share" feature (for example, to send the conversation to family and… pic.twitter.com/PBsCddfJyv

— Luiza Jarovsky, PhD (@LuizaJarovsky) July 31, 2025

האם פרטיות בכלל אפשרית מול כלי ה-AI החדשים?

התקרית הזו מדגישה מתח הולך וגובר בין השימוש ב-AI לבין פרטיות המשתמשים. קרייסה ווליז, אתיקאית AI מאוניברסיטת אוקספורד, ציינה בתגובה לפרשה כי "חברות טכנולוגיה משתמשות באוכלוסייה הכללית כשפני ניסיונות. הן עושות משהו, מנסות אותו על האוכלוסייה, ובודקות אם מישהו מתלונן".

רייצ'ל טובאק, אנליסטית אבטחת סייבר ומנכ"לית SocialProof Security, הוסיפה כי "אנשים מצפים שהם יוכלו להשתמש בכלים כמו ChatGPT באופן פרטי לחלוטין, אך המציאות היא שמשתמשים רבים אינם תופשים לגמרי שלפלטפורמות אלו יש תכונות שעלולות להדליף בטעות את שאלותיהם, סיפוריהם ופחדיהם הפרטיים ביותר".

גם ד"ר לואיזה ירובוסקי, אתיקאית פרטיות ומייסדת-שותפה של AITechPrivacy.com, צייצה בתגובה לחשיפה והדגישה את ההלם מהגילוי כי אינטראקציות עם ChatGPT הופכות לציבוריות ונסרקות על ידי גוגל. היא ציינה שבבדיקותיה האישיות, אף על פי שלא נחשפה לשמות משתמשים (אלא למשתמשים אנונימיים), המידע שהוזן עדיין עלול לחשוף זהויות.

לדבריה, "הרוב המכריע של האנשים אינם סבורים שאינטראקציות אלו עשויות להפוך לניתנות לאינדוקס, ורבים יכולים לשתף פרטים אישיים או אינטימיים על עצמם או על אחרים. הם יחושו חרדה עמוקה אם יגלו שיש קישור ציבורי לאינטראקציות אלו בגוגל (ואחרים עלולים לראות אותן)". לאור זאת, ירובוסקי ממליצה בחום למשתמשים לנקוט אמצעי זהירות נוספים: להימנע לחלוטין משימוש בשיתוף פלטי הצ'טבוט דרך קישורים, שכן אינטראקציות אלו עלולות להפוך לניתנות לאינדוקס. כמו כן, היא המליצה שלא לשתף לעולם מידע אישי על עצמך או על אחרים עם הבוט, בשל סכנת דליפות בלתי צפויות. ד"ר ירובוסקי גם הוסיפה המלצות כמו ביטול תכונת הזיכרון של הצ'טבוט, מה שמפחית את כמות הנתונים האישיים המעובדים ומקושרים למידע אחר על המשתמש. בנוסף, היא קוראת להפוך בהגדרות את השיחות לאנונימיות ולבטל אישור לאימון ה-AI עליהן, כדי לצמצם את כמות המידע המעובד שעלול לדלוף.

על פי המדיה העולמית, השערורייה הזו גם מצביעה על הצורך בשינויים מערכתיים, כולל הגדרות noindex כברירת מחדל, ועל חובה ב"חינוך משתמשים" כיצד לנהוג מול כלי ה-AI השונים.

נזכיר כי מנכ"ל OpenAI, סם אלטמן, בעצמו הזהיר בעבר שמשתמשים צריכים להימנע מהכנסת הנתונים האישיים ביותר שלהם לשיחותיהם עם ChatGPT, מכיוון שהחברה עלולה להידרש חוקית למסור יומני צ'אט שלהם לרשויות החוק, מטעמים שונים, ולא תוכל לסרב לכך.

יצוין עם זאת כי עקב תביעה משפטית מתמשכת שספגה מהניו יורק טיימס בנוגע לחששות זכויות יוצרים OpenAI במהלך אימון כליה, השעתה החברה את מחזור המחיקה הרגיל של היסטוריות הצ'אט. משמעות הדבר היא שכל מה שהמשתמשים הזינו – כולל סודות מסחריים, עניינים משפטיים וגילויים אינטימיים – זמין כעת לצוותים המשפטיים הפנימיים של OpenAI, ועלול אף להיות כפוף לצווי גילוי עתידיים.

תגובות

(0)